كيفية التحقيق في نشاط ChatGPT في Google Workspace

منذ إطلاق ChatGPT في عام 2022، تحدت OpenAI التوقعات من خلال دفق مستمر من إعلانات المنتجات والتحسينات. جاء أحد هذه الإعلانات في 16 مايو 2024، وربما بدا الأمر غير ضار بالنسبة لمعظم المستهلكين. بعنوان “تحسينات على تحليل البيانات في ChatGPT،” يوضح المنشور كيف يمكن للمستخدمين إضافة الملفات مباشرة من Google Drive وMicrosoft OneDrive. ومن الجدير بالذكر أن أدوات genAI الأخرى مثل Google AI Studio وClaude Enterprise أضافت أيضًا إمكانات مماثلة مؤخرًا. عظيم جدا، أليس كذلك؟ ربما

عند ربط حساب مؤسستك على Google Drive أو OneDrive بـ ChatGPT (أو أدوات genAI الأخرى)، فإنك تمنحها أذونات واسعة ليس فقط لملفاتك الشخصية، بل أيضًا للموارد عبر محرك الأقراص المشترك بالكامل. كما قد تتخيل، فإن فوائد هذا النوع من التكامل الشامل تأتي مع مجموعة من تحديات الأمن السيبراني.

إذًا، كيف يمكنك معرفة ما إذا كان الموظفون قد قاموا بتمكين التكامل بين ChatGPT وGoogle Drive، وكيف يمكنك مراقبة الملفات التي تم الوصول إليها؟ تتناول هذه المقالة كيفية القيام بذلك محليًا في Google Workspace وكيفية القيام بذلك دفعة الأمن يمكن أن تساعدك في اكتشاف جميع تطبيقات genAI المستخدمة، والتطبيقات الأخرى التي تم دمجها معها.

مكان رؤية نشاط ChatGPT في Google Workspace

في Google Workspace، هناك طريقتان لتحديد النشاط المرتبط باتصال ChatGPT والتحقيق فيه.

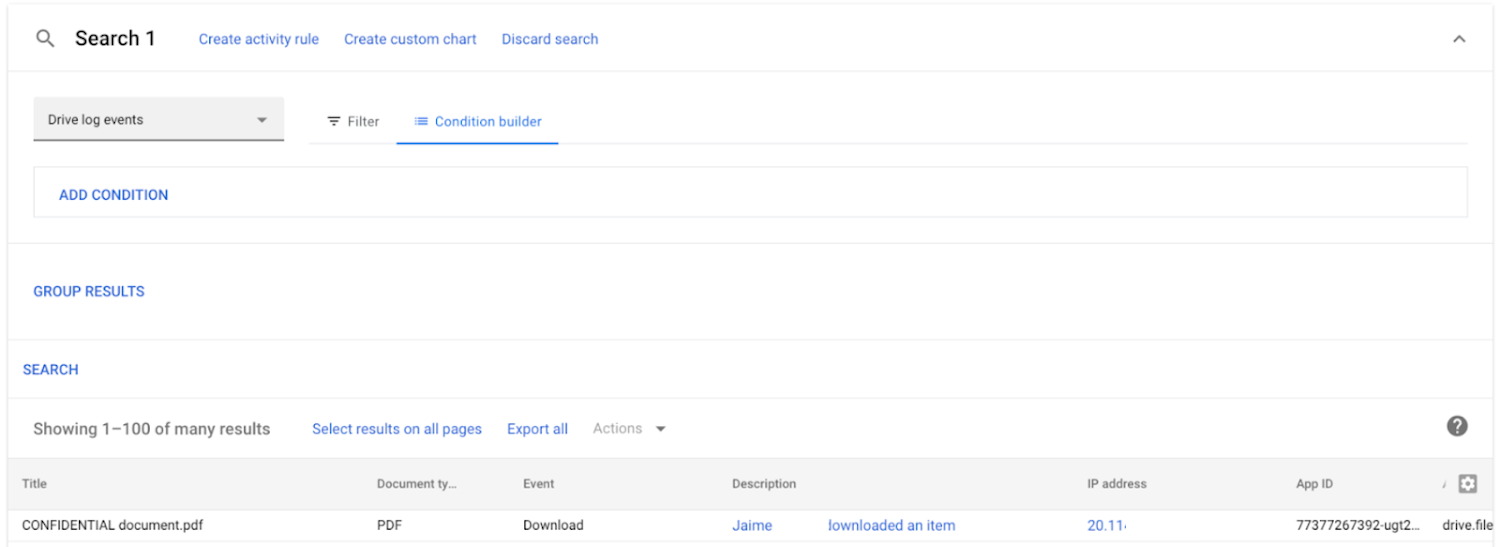

من وحدة تحكم المشرف في Google Workspace، انتقل إلى إعداد التقارير > التدقيق والتحقيق > أحداث سجل Drive. هنا سترى قائمة بموارد Google Drive التي تم الوصول إليها.

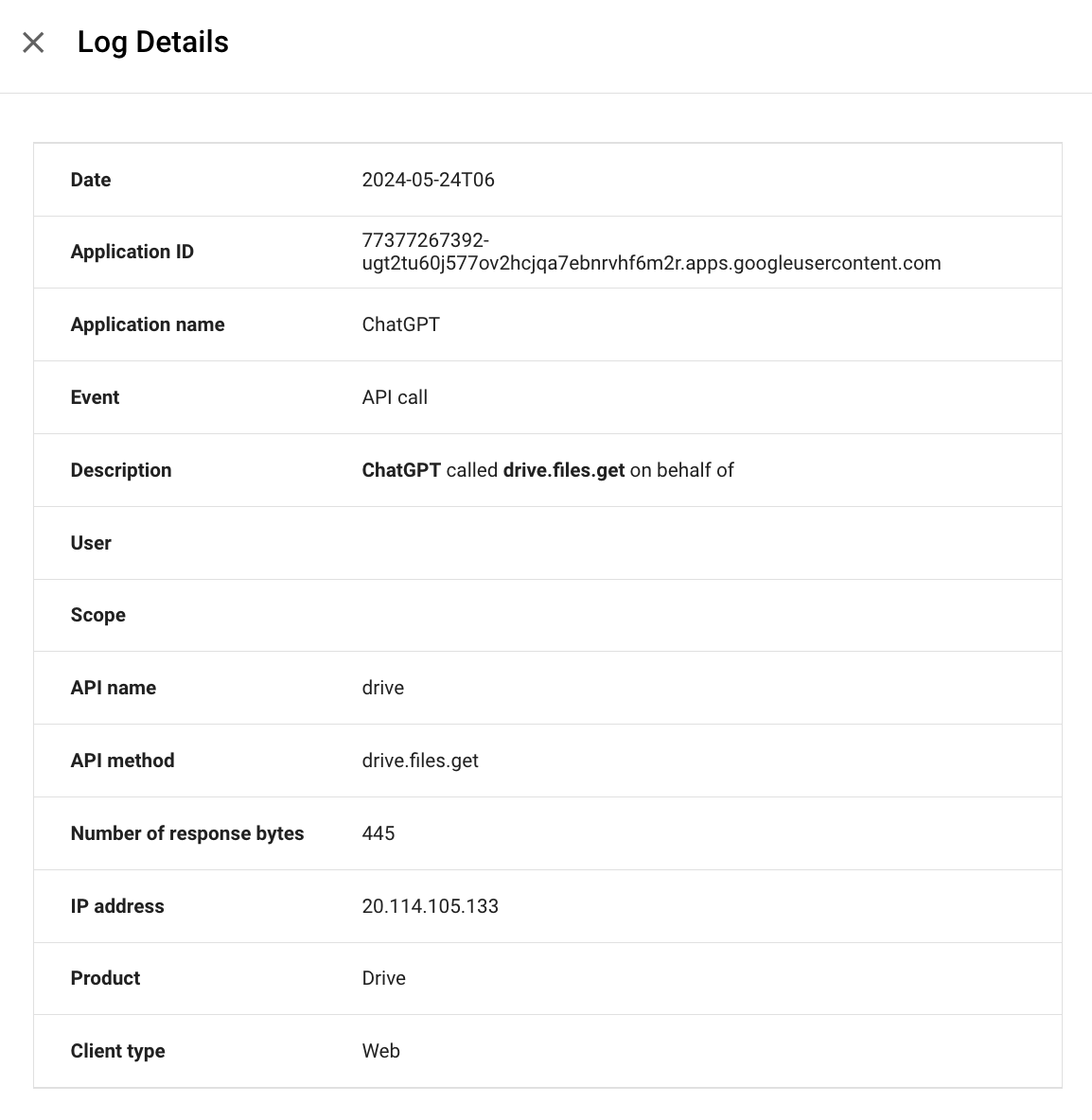

يمكنك أيضًا التحقيق في النشاط عبر مكالمات واجهة برمجة التطبيقات (API) ضمن إعداد التقارير → التدقيق والتحقيق → أحداث سجل Oauth.

لذا، يمكن أن يساعدك التحقق بشكل دوري من وحدة تحكم المشرف في Google Workspace في فهم الموارد التي يتم الوصول إليها بواسطة ChatGPT، ولكن رؤية هذا النشاط بعد حدوثه بالفعل أقل قيمة بالطبع من الحصول على تنبيه بمجرد إنشاء عمليات تكامل جديدة مع ChatGPT. هذا هو المكان الذي يمكن أن يساعد فيه أمان Nudge.

كيفية رؤية جميع عمليات تكامل genAI مع Nudge Security

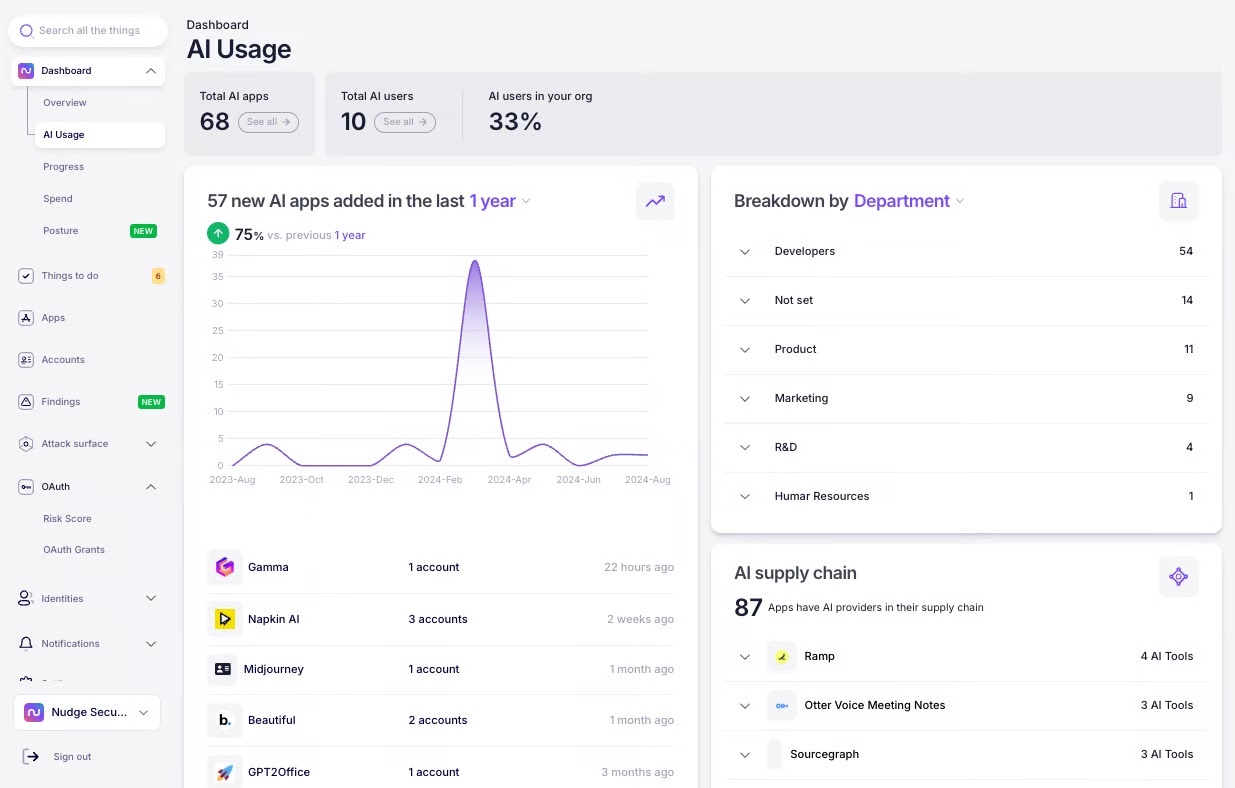

يكتشف Nudge Security جميع الحسابات التي أنشأها أي شخص في مؤسستك لأي تطبيق SaaS، بما في ذلك ChatGPT والقائمة الآخذة في الاتساع لأدوات genAI المنشأة حديثًا، دون الحاجة إلى أي معرفة مسبقة بوجود الأداة. باستخدام لوحة معلومات الذكاء الاصطناعي المدمجة، يمكن للعملاء مواكبة اعتماد الذكاء الاصطناعي بشكل استباقي التخفيف من المخاطر الأمنية للذكاء الاصطناعي.

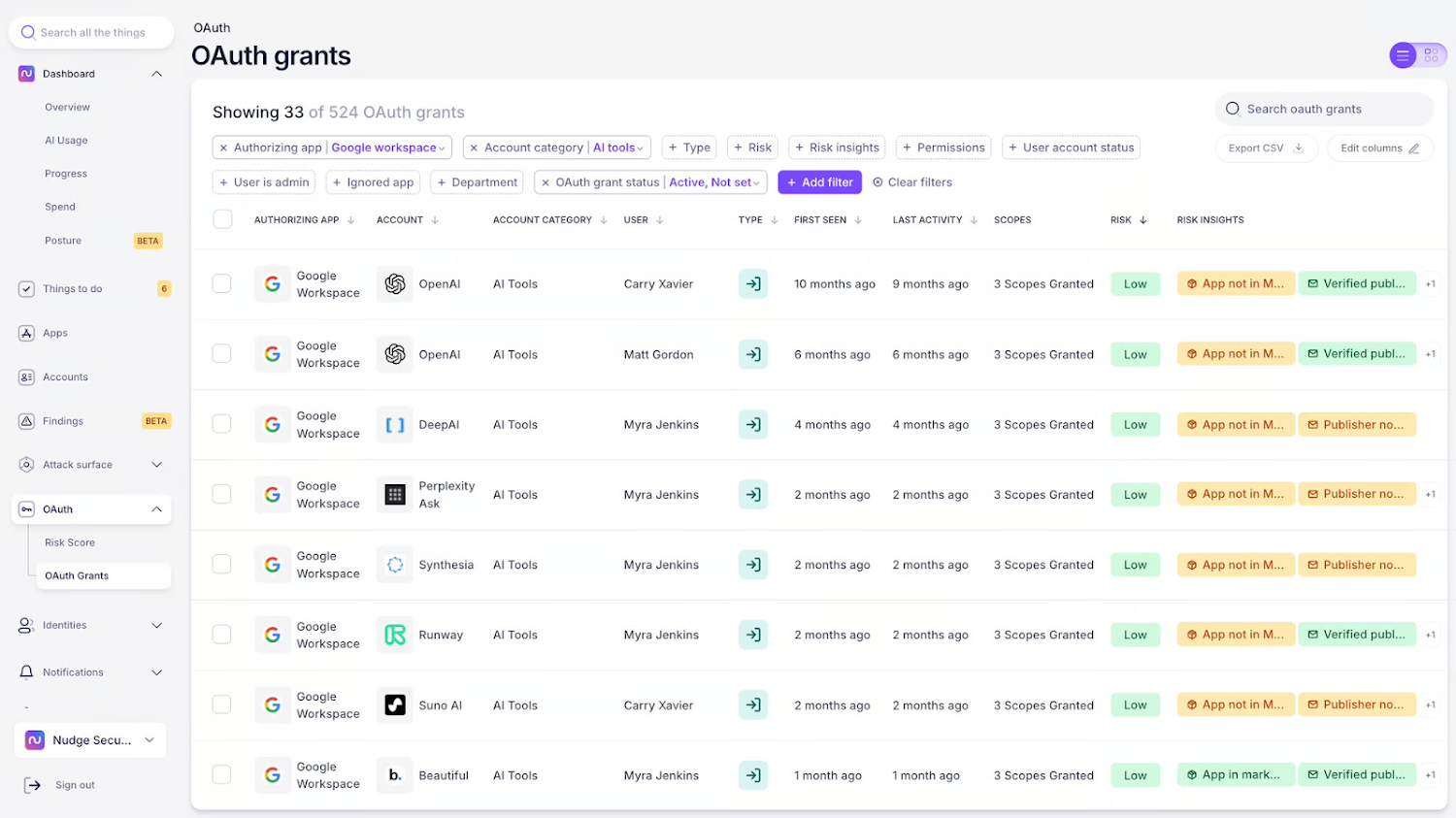

بالإضافة إلى ذلك، يعرض Nudge Security منح OAuth الخاصة بمؤسستك بأكملها، مثل تلك الممنوحة لـ ChatGPT، ضمن لوحة معلومات OAuth قابلة للتصفية والتي تتضمن نوع المنحة (تسجيل الدخول أو التكامل)، والنشاط، ورؤى المخاطر. قم بالتصفية حسب الفئة لرؤية جميع المنح المرتبطة بأدوات الذكاء الاصطناعي:

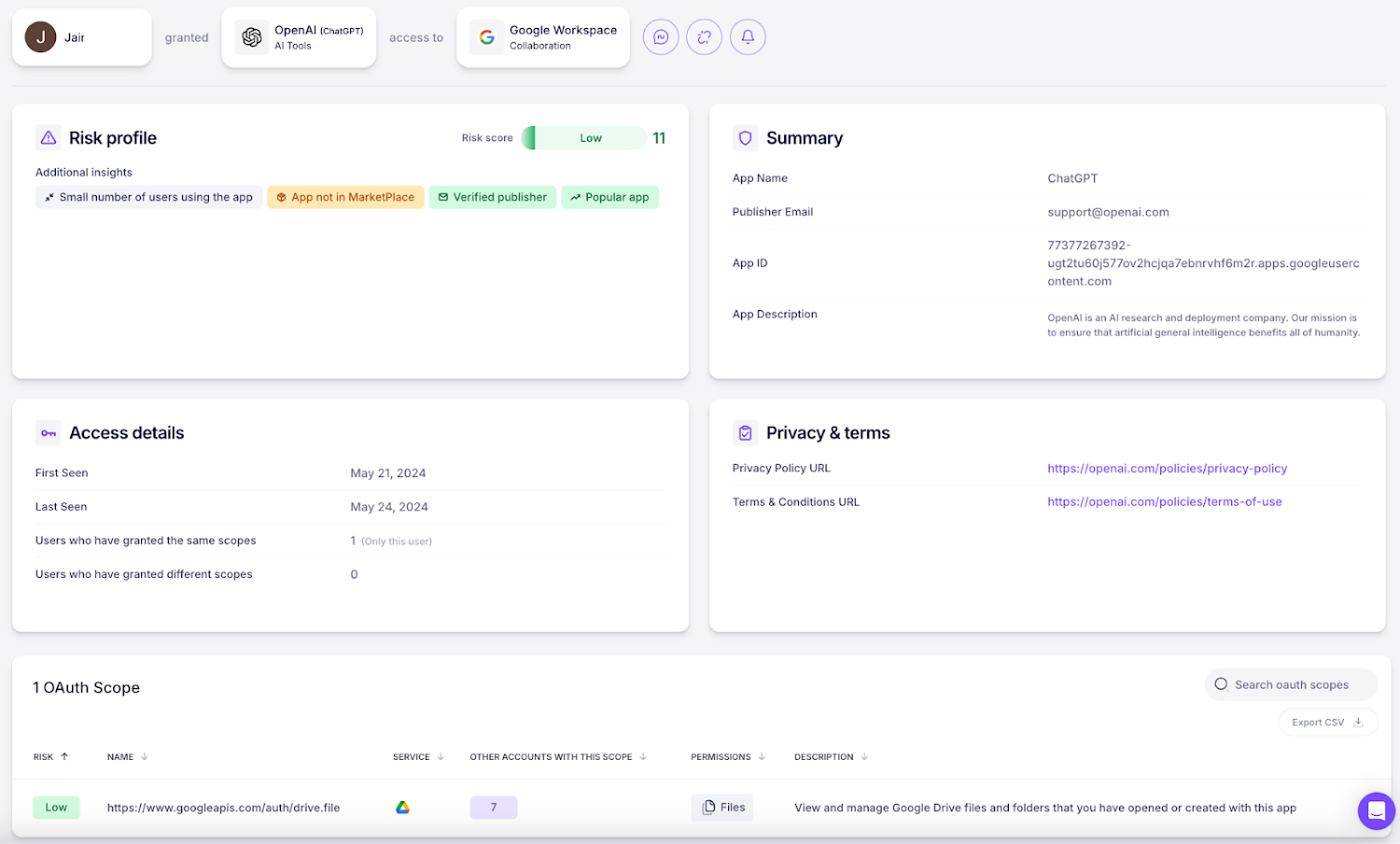

انقر فوق المنحة لفتح شاشة التفاصيل، حيث يمكنك مراجعة ملف تعريف المخاطر، وتفاصيل حول من قام بإنشاء المنحة ومتى، وتفاصيل الوصول، والنطاقات الممنوحة، والمزيد:

يمكنك بعد ذلك إرسال “دفعة” إلى منشئ المنحة عبر Slack أو البريد الإلكتروني لاتخاذ إجراء معين، مثل الحد من نطاق المنحة، أو يمكنك إلغاء المنحة على الفور من داخل واجهة مستخدم Nudge Security.

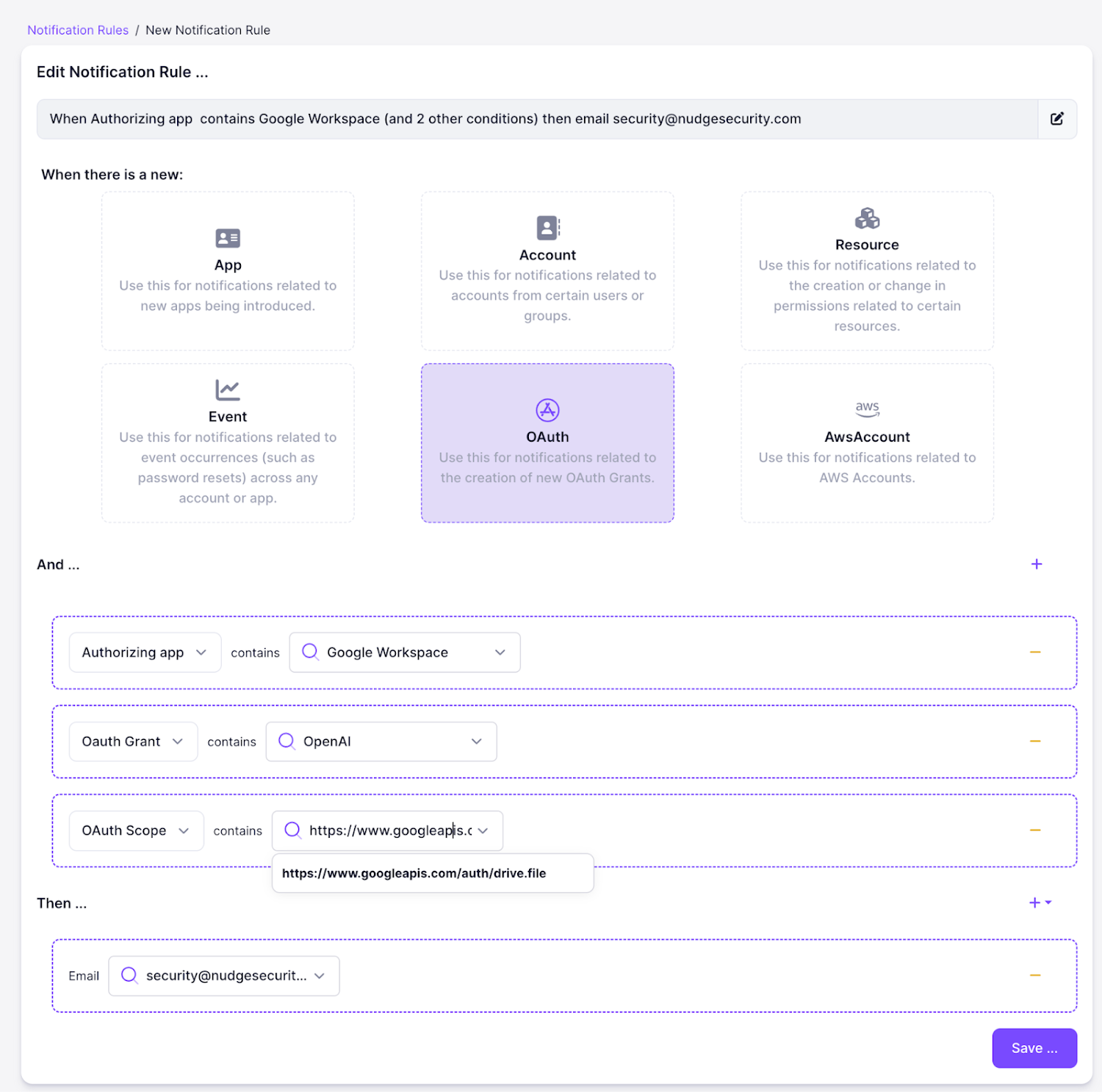

أخيرًا، يمكنك إعداد قاعدة مخصصة للتأكد من إعلامك عندما يقوم مستخدم في مؤسستك بإنشاء منحة OAuth لـ ChatGPT – أو أي تطبيق genAI آخر في هذا الشأن. يمكنك أيضًا إنشاء قواعد ليتم تنبيهك على الفور عند إنشاء حسابات genAI جديدة، ودفع مستخدمي genAI الجدد لمراجعة سياسة الاستخدام المقبولة لـ genAI والإقرار بها.

تحقيق التوازن بين الإنتاجية والأمن

في حين أن تكامل ChatGPT مع Google Drive وMicrosoft OneDrive يوفر إمكانات هائلة لتحسين الإنتاجية، فإنه يفتح الباب أيضًا أمام مخاطر أمنية كبيرة. يجب على المؤسسات التعامل مع عمليات التكامل هذه بفهم واضح للمخاطر المحتملة وتنفيذ إجراءات الإدارة والأمن المناسبة للتخفيف منها.

يوفر Nudge Security الرؤية بالإضافة إلى السياق والأتمتة لمساعدة الشركات على اعتماد أدوات الذكاء الاصطناعي الجيني دون المساس بأمن البيانات.

ابدأ نسخة تجريبية مجانية مدتها 14 يومًا اليوم لتكتشف على الفور جميع تطبيقات genAI التي تم تقديمها لمؤسستك إلى جانب جميع عمليات التكامل في تطبيقاتك الأخرى.

منذ إطلاق ChatGPT في عام 2022، تحدت OpenAI التوقعات من خلال دفق مستمر من إعلانات المنتجات والتحسينات. جاء أحد هذه الإعلانات في 16 مايو 2024، وربما بدا الأمر غير ضار بالنسبة لمعظم المستهلكين. بعنوان “تحسينات على تحليل البيانات في ChatGPT،” يوضح المنشور كيف يمكن للمستخدمين إضافة الملفات مباشرة من Google Drive وMicrosoft OneDrive. ومن الجدير بالذكر أن أدوات genAI الأخرى مثل Google AI Studio وClaude Enterprise أضافت أيضًا إمكانات مماثلة مؤخرًا. عظيم جدا، أليس كذلك؟ ربما

عند ربط حساب مؤسستك على Google Drive أو OneDrive بـ ChatGPT (أو أدوات genAI الأخرى)، فإنك تمنحها أذونات واسعة ليس فقط لملفاتك الشخصية، بل أيضًا للموارد عبر محرك الأقراص المشترك بالكامل. كما قد تتخيل، فإن فوائد هذا النوع من التكامل الشامل تأتي مع مجموعة من تحديات الأمن السيبراني.

إذًا، كيف يمكنك معرفة ما إذا كان الموظفون قد قاموا بتمكين التكامل بين ChatGPT وGoogle Drive، وكيف يمكنك مراقبة الملفات التي تم الوصول إليها؟ تتناول هذه المقالة كيفية القيام بذلك محليًا في Google Workspace وكيفية القيام بذلك دفعة الأمن يمكن أن تساعدك في اكتشاف جميع تطبيقات genAI المستخدمة، والتطبيقات الأخرى التي تم دمجها معها.

مكان رؤية نشاط ChatGPT في Google Workspace

في Google Workspace، هناك طريقتان لتحديد النشاط المرتبط باتصال ChatGPT والتحقيق فيه.

من وحدة تحكم المشرف في Google Workspace، انتقل إلى إعداد التقارير > التدقيق والتحقيق > أحداث سجل Drive. هنا سترى قائمة بموارد Google Drive التي تم الوصول إليها.

يمكنك أيضًا التحقيق في النشاط عبر مكالمات واجهة برمجة التطبيقات (API) ضمن إعداد التقارير → التدقيق والتحقيق → أحداث سجل Oauth.

لذا، يمكن أن يساعدك التحقق بشكل دوري من وحدة تحكم المشرف في Google Workspace في فهم الموارد التي يتم الوصول إليها بواسطة ChatGPT، ولكن رؤية هذا النشاط بعد حدوثه بالفعل أقل قيمة بالطبع من الحصول على تنبيه بمجرد إنشاء عمليات تكامل جديدة مع ChatGPT. هذا هو المكان الذي يمكن أن يساعد فيه أمان Nudge.

كيفية رؤية جميع عمليات تكامل genAI مع Nudge Security

يكتشف Nudge Security جميع الحسابات التي أنشأها أي شخص في مؤسستك لأي تطبيق SaaS، بما في ذلك ChatGPT والقائمة الآخذة في الاتساع لأدوات genAI المنشأة حديثًا، دون الحاجة إلى أي معرفة مسبقة بوجود الأداة. باستخدام لوحة معلومات الذكاء الاصطناعي المدمجة، يمكن للعملاء مواكبة اعتماد الذكاء الاصطناعي بشكل استباقي التخفيف من المخاطر الأمنية للذكاء الاصطناعي.

بالإضافة إلى ذلك، يعرض Nudge Security منح OAuth الخاصة بمؤسستك بأكملها، مثل تلك الممنوحة لـ ChatGPT، ضمن لوحة معلومات OAuth قابلة للتصفية والتي تتضمن نوع المنحة (تسجيل الدخول أو التكامل)، والنشاط، ورؤى المخاطر. قم بالتصفية حسب الفئة لرؤية جميع المنح المرتبطة بأدوات الذكاء الاصطناعي:

انقر فوق المنحة لفتح شاشة التفاصيل، حيث يمكنك مراجعة ملف تعريف المخاطر، وتفاصيل حول من قام بإنشاء المنحة ومتى، وتفاصيل الوصول، والنطاقات الممنوحة، والمزيد:

يمكنك بعد ذلك إرسال “دفعة” إلى منشئ المنحة عبر Slack أو البريد الإلكتروني لاتخاذ إجراء معين، مثل الحد من نطاق المنحة، أو يمكنك إلغاء المنحة على الفور من داخل واجهة مستخدم Nudge Security.

أخيرًا، يمكنك إعداد قاعدة مخصصة للتأكد من إعلامك عندما يقوم مستخدم في مؤسستك بإنشاء منحة OAuth لـ ChatGPT – أو أي تطبيق genAI آخر في هذا الشأن. يمكنك أيضًا إنشاء قواعد ليتم تنبيهك على الفور عند إنشاء حسابات genAI جديدة، ودفع مستخدمي genAI الجدد لمراجعة سياسة الاستخدام المقبولة لـ genAI والإقرار بها.

تحقيق التوازن بين الإنتاجية والأمن

في حين أن تكامل ChatGPT مع Google Drive وMicrosoft OneDrive يوفر إمكانات هائلة لتحسين الإنتاجية، فإنه يفتح الباب أيضًا أمام مخاطر أمنية كبيرة. يجب على المؤسسات التعامل مع عمليات التكامل هذه بفهم واضح للمخاطر المحتملة وتنفيذ إجراءات الإدارة والأمن المناسبة للتخفيف منها.

يوفر Nudge Security الرؤية بالإضافة إلى السياق والأتمتة لمساعدة الشركات على اعتماد أدوات الذكاء الاصطناعي الجيني دون المساس بأمن البيانات.

ابدأ نسخة تجريبية مجانية مدتها 14 يومًا اليوم لتكتشف على الفور جميع تطبيقات genAI التي تم تقديمها لمؤسستك إلى جانب جميع عمليات التكامل في تطبيقاتك الأخرى.